把 Claude Code 的请求入口切到 DeepSeek 的 Anthropic 兼容接口,再把主模型设成 deepseek-v4-pro[1m],就能在 Claude Code 里使用 DeepSeek V4 Pro 的长上下文和更高思考等级。

适合谁看?

- 已经在用 Claude Code,但想试试 DeepSeek V4 Pro 的人

- 想要更长上下文处理大项目的人

- 想降低 AI 编程工具使用成本的人

这套方案的重点不是“安装一个新 IDE”,而是复用 Claude Code 的终端交互体验,把底层模型服务换成 DeepSeek。

你可以把它理解成:

Claude Code 负责交互和工具调用体验

DeepSeek API 负责模型推理

环境变量负责把两边接起来官方文档里给出的关键配置是这几个:

export ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic

export ANTHROPIC_AUTH_TOKEN=<你的 DeepSeek API Key>

export ANTHROPIC_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_OPUS_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_SONNET_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_HAIKU_MODEL=deepseek-v4-flash

export CLAUDE_CODE_SUBAGENT_MODEL=deepseek-v4-flash

export CLAUDE_CODE_EFFORT_LEVEL=max这里最值得注意的是两点:

deepseek-v4-pro[1m]:主模型使用 1M 上下文版本,适合读大项目、大文件、多轮任务。CLAUDE_CODE_EFFORT_LEVEL=max:把 Claude Code 的思考等级拉到更高档位,适合复杂规划和多步骤代码任务。

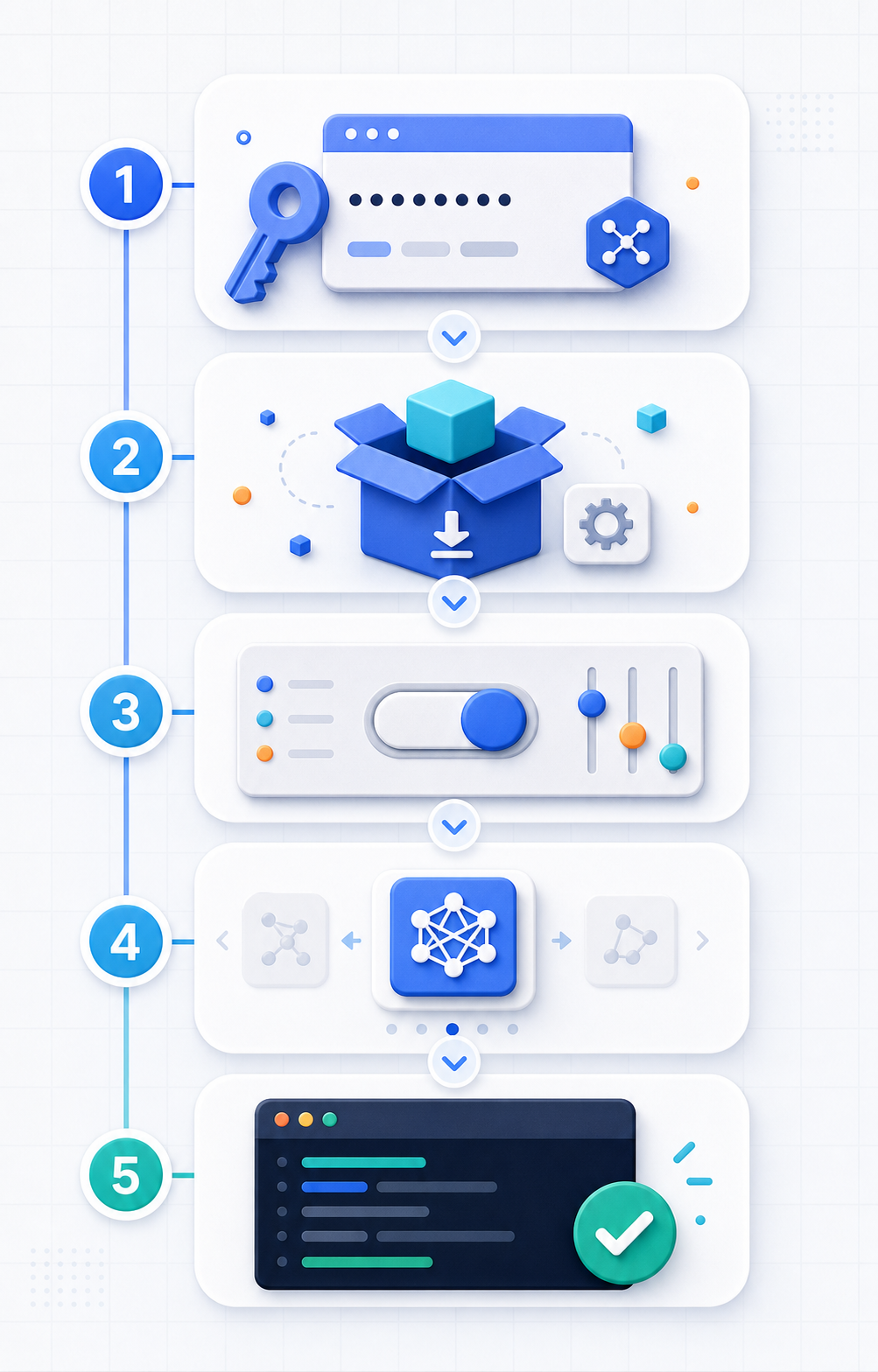

照做流程

1. 准备 Claude Code

如果你还没有 Claude Code,先装 Node.js 18+,再安装 Claude Code:

npm install -g @anthropic-ai/claude-code检查是否安装成功:

claude --version2. 创建 DeepSeek API Key

进入 DeepSeek API 开放平台,创建一个 API Key。

地址:

https://platform.deepseek.com/api_keys注意:API Key 只在创建时完整显示,建议放到密码管理器或本地安全环境变量里,不要写进公开仓库。

3. 配置 Claude Code 使用 DeepSeek

Mac / Linux 直接在终端执行:

export ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic

export ANTHROPIC_AUTH_TOKEN=<你的 DeepSeek API Key>

export ANTHROPIC_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_OPUS_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_SONNET_MODEL=deepseek-v4-pro[1m]

export ANTHROPIC_DEFAULT_HAIKU_MODEL=deepseek-v4-flash

export CLAUDE_CODE_SUBAGENT_MODEL=deepseek-v4-flash

export CLAUDE_CODE_EFFORT_LEVEL=max如果你不想每次开终端都重新 export,可以写入 ~/.zshrc:

nano ~/.zshrc保存后刷新:

source ~/.zshrc4. 进入项目运行

cd /path/to/my-project

claude如果能正常进入 Claude Code,并且请求走 DeepSeek API,就说明接入完成。

这个配置真正解决什么问题?

1. 大项目上下文更够用

普通代码助手经常卡在“只能看局部文件”。

1M 上下文的价值在于:它更适合让模型一次性理解更多代码、文档、错误日志和需求说明。

它不等于永远不会出错,但能明显减少“刚说过的背景又忘了”的情况。

2. Claude Code 的终端体验还能保留

Claude Code 的优势是命令行里的工程工作流:

- 能在项目目录里理解文件结构

- 能围绕任务拆解步骤

- 能配合代码修改和验证

- 比网页聊天更贴近真实开发现场

接入 DeepSeek 后,你保留的是这套工作方式,替换的是模型服务入口。

3. 子任务可以用更轻模型

配置里把主模型设成 deepseek-v4-pro[1m],把部分子任务模型设成 deepseek-v4-flash。

这样做的思路很实用:

- 复杂规划、架构理解、长上下文任务交给 Pro

- 较轻的子任务交给 Flash

- 在体验和成本之间做平衡

我建议你这样用

不要一上来就让它“重构整个项目”。

更稳的方式是先给它小目标:

先阅读这个项目结构,告诉我启动入口、核心模块和主要依赖。然后再进入具体任务:

帮我定位这个报错来自哪里,只分析,不要改代码。确认分析靠谱后,再让它动手:

按最小改动修复这个问题,并告诉我改了哪些文件。这样用,比直接一句“帮我优化项目”更容易得到可靠结果。

风险提醒

这套方案虽然方便,但有几个点要注意:

- API Key 不要提交到 Git 仓库。

- 长上下文不等于免费上下文。 大项目输入越多,Token 消耗越高。

- Max 思考等级适合复杂任务。 日常小改动不一定需要一直开最高档。

- 涉及生产代码时,必须自己 review。 AI 能提速,但不能替代工程责任。

- 模型和接口名称可能变动。 真正使用前,以 DeepSeek 官方文档为准。

DeepSeek V4 Pro 已经可以接入 Claude Code。

核心就是把 Claude Code 的 Anthropic 接口地址换成:

https://api.deepseek.com/anthropic然后把主模型设为:

deepseek-v4-pro[1m]再把思考等级拉到:

max这样你就可以继续用 Claude Code 的终端开发体验,同时让底层请求走 DeepSeek。

我觉得这个组合最适合三类任务:

- 读大项目

- 分析复杂报错

- 做多文件代码改造

但别把它当魔法。API Key 要管好,Token 成本要看住,生产代码一定要 review。